NTTは2023年11月1日、大規模言語モデル「tsuzumi(つづみ)」を発表した。6億パラメータの超軽量版(CPUで推論動作可能)と、70億パラメータの軽量版(1GPUで推論動作可能)の2種類のLLMを開発した。日本語と英語を扱え、特に日本語処理能力が高いのが特徴。2024年3月に商用サービスとして提供する。提供に先立ち、京都大学医学部附属病院(医療分野)や東京海上日動火災保険(コンタクトセンター分野)のパートナーとトライアル運用を開始している。

NTTの「tsuzumi」は、同社グループが開発した大規模言語モデル(LLM)である。日本語と英語を扱え、2024年3月に商用サービスとして提供する。提供に先立ち、京都大学医学部附属病院(医療分野)や東京海上日動火災保険(コンタクトセンター分野)のパートナーとトライアル運用を開始している。

6億パラメータの超軽量版(CPUで推論動作可能)と、70億パラメータの軽量版(1GPUで推論動作可能)の2種類のLLMを開発した。米OpenAIのGPT-3(1750億パラメータ)と比べると約300分の1(超軽量版)や25分の1(軽量版)という軽量さが特徴。軽量版は1GPUで、超軽量版はCPUで高速な推論動作が可能という。

軽量なLLMであることから、チューニングや推論に必要なコストを抑えられる。NTTの試算によれば、GPUクラウドの利用料金換算で、学習コストが上記のパラメータ数比較と同様で、推論コストが約70分の1(超軽量版)や20分の1(軽量版)となる(図1)。

図1:軽量LLMのコストメリット(出典:NTT)

図1:軽量LLMのコストメリット(出典:NTT)拡大画像表示

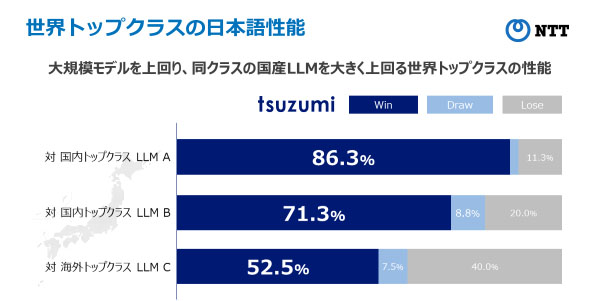

国産LLMとして、特に日本語処理の性能が高いとしている。生成AI向けベンチマークである「Rakuda」では、GPT-3.5などのLLM群を上回っている。今後、日本語と英語以外の言語にも対応する予定である(図2)。

図2:日本語性能に関するtsuzumiと他LLMとのベンチマーク結果比較(出典:NTT)

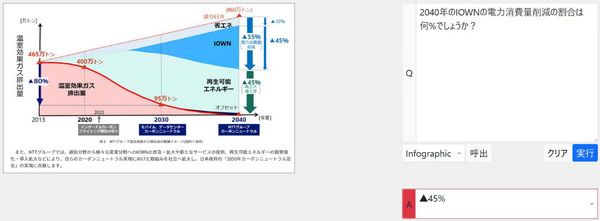

図2:日本語性能に関するtsuzumiと他LLMとのベンチマーク結果比較(出典:NTT) 知識を追加で学習させるためのアダプタを提供し、例えば、業界特有の言語表現や知識から回答するためのチューニングを、少ない追加学習量で実現できる。また、言語化していないグラフなどの図版や音声のニュアンス/顔の表情などを理解できるようにする計画である(図3)。

図3:視覚的読解技術の実施例(出典:NTT)

図3:視覚的読解技術の実施例(出典:NTT)拡大画像表示

NTTはまず、tsuzumiの特性を生かして、業界に特化した領域にフォーカスする。全知識を集約した1つの巨大なLLMを構築するのではなく、専門性や個性を長所にした小規模なLLMの集合知が複数のAI群と連携して社会課題を解決する世界を目指すとしている。

大量のLLMの連携基盤には低遅延ネットワーク環境が必要になるが、NTTは、tsuzumiの学習のために光ネットワークを利用した環境を構築。数百km離れたデータセンター間でGPUとストレージを接続している。

なお、tsuzumiの名称についてNTTは、「日本語の処理性能を重視し産業の発展を牽引する言語モデル技術への期待を、雅楽の合奏の開始の切っ掛けを担う鼓に寄せた」と説明している。