[新製品・サービス]

富士通、生成AIの回答誤りを検出する技術を開発、フィッシングURLも指摘

2023年9月26日(火)日川 佳三(IT Leaders編集部)

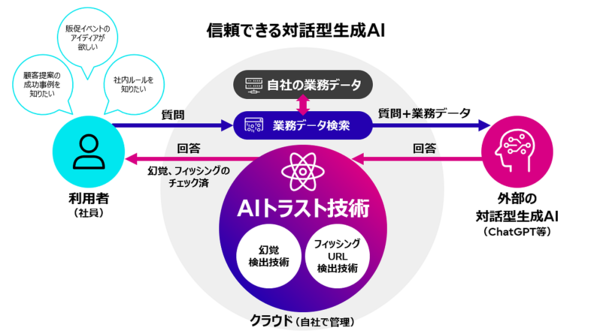

富士通は2023年9月26日、生成AIで対話から得られる回答の信頼性を確保する2つの技術を開発したと発表した。1つは誤りやすい固有名詞や数値などを空欄にして繰り返し質問することで、ハルシネーション(もっともらしい誤り)を検出する技術。もう1つは回答に含まれるフィッシングサイトURLを検出して指摘する技術。富士通は、両技術を同社の対話型生成AIコアエンジンに適用する。ハルシネーション検出は同年9月28日から、フィッシングURL検出は同年10月から国内で提供開始し、順次グローバルに展開する。

富士通は、生成AIで対話から得られる回答の信頼性を確保する2つの技術を開発した。1つは、誤りやすい固有名詞や数値などを空欄にして繰り返し質問することで、ハルシネーション(幻覚、注1)と呼ばれるもっともらしい誤りを検出する「幻覚検出技術」。もう1つは、回答に含まれるフィッシングサイトURLを検出して危険性を指摘する「フィッシングURL検出技術」である(図1)。

注1:ハルシネーション(Hallucination:幻覚、幻影)は、AIが事実に基づかない情報を生成する現象のこと。生成AIでは、大規模言語モデルの特性上、事実とは異なるもっともらしい偽の情報を出力することがしばしば見られる。

図1:信頼できる対話型生成AIの全体イメージ(出典:富士通)

図1:信頼できる対話型生成AIの全体イメージ(出典:富士通)拡大画像表示

穴埋め質問を繰り返してハルシネーションを検出

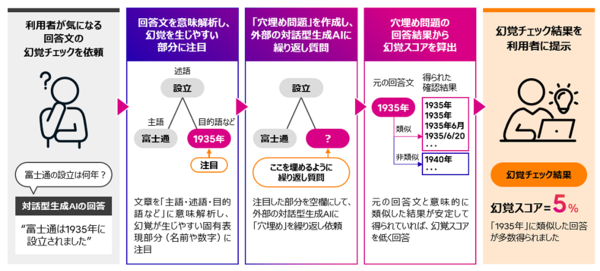

(1)幻覚検出は、ハルシネーションを検出してスコア化する技術。「WikiBio GPT-3 Hallucination Dataset」などのオープンデータを用いたベンチマーク試験では、SelfCheckGPTなど他のハルシネーション検出手法と比べて、検出の正確さの指標(AUC-ROC)が約22%向上したという。

「生成AIを業務に適用する際には、事前に登録した業務データから質問に関連する情報を抽出し、外部の生成AIに質問する際に参考情報として付加する方法がよく用いられる。この方法は業務に関する回答が正確になり、ハルシネーションを抑える効果がある。しかし、質問に関連した情報を上手く抽出できないケースではそれが発生してしまう」(富士通)

これまでも、回答のハルシネーションの度合い(幻覚スコア)を推測する取り組みはあったが、生成AIは同じ意味でも複数の文章表現で回答するため、スコアの正確な推測は困難だった。

富士通は今回、幻覚が固有名詞や数値などの固有表現の部分で生じやすく、質問のたびに回答内容が変化しやすい傾向があることを踏まえ、ハルシネーションが生じやすい箇所を特定して重点的に確認する手法として幻覚検出技術を開発した(図2)。

図2:「幻覚検出技術」の動作イメージ(出典:富士通)

図2:「幻覚検出技術」の動作イメージ(出典:富士通)拡大画像表示

仕組みとしては、回答文を主語・述語・目的語などに分解し、その中の固有表現部分を特定し、かつそこを空欄にして尋ねる穴埋め質問を自動作成し、外部の対話型生成AIに複数回質問する。これにより、固有表現部分の回答のばらつきを捉え、幻覚スコアを高精度に算出できるようにした。

●Next:フィッシングURL検出技術の仕組み

会員登録(無料)が必要です

- 1

- 2

- 次へ >