富士通は2023年9月15日、独自開発してきた2つのAI技術をオープンソースプロジェクトとしてThe Linux Foundationに提案し、2023年8月24日までに承認されたと発表した。自動機械学習技術「SapientML」とAI公平性技術「Intersectional Fairness」である。同年9月19日開催の「Open Source Summit Europe 2023」においてLinux Foundationプロジェクトとして正式に始動する。

富士通は、これまで独自に開発してきた2つのAI技術を、オープンソースプロジェクトとしてThe Linux Foundationに提案した。Linux Foundationは、非営利の技術コンソーシアムで、年間で数十件の技術をオープンソースソフトウェア(OSS)のプロジェクトとして承認している。

(1)自動機械学習技術「SapientML(セイピエントエムエル)」と、(2)AI公平性技術「Intersectional Fairness」が、2023年8月24日までに承認を受けた。同年9月19日開催の「Open Source Summit Europe 2023」において、Linux Foundationのプロジェクトとして正式に始動する。

(1)SapientMLは、説明性の高いAIモデルを自動作成する、自動機械学習技術(AutoML)である。表データを基に説明付きの機械学習モデルを作成するコードを生成する。「データサイエンティストは、同技術を使うことで高精度なモデルを短時間で作成できるようになる。また、生成されたコードを使って試行錯誤することで、より高精度なモデルに作り変えられる」(同社)と説明している(図1)。

図1:説明性の高いAIモデルを自動で作成するSapientMLの概要(出典:富士通)

図1:説明性の高いAIモデルを自動で作成するSapientMLの概要(出典:富士通)拡大画像表示

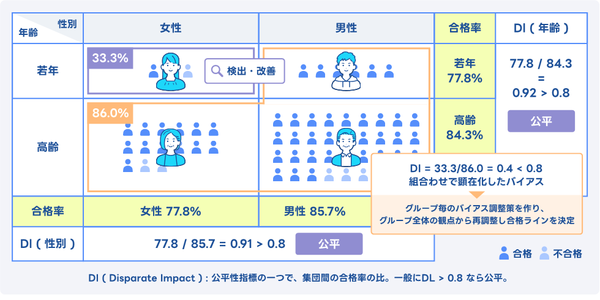

(2)Intersectional Fairnessは、人が気づきにくいバイアスを検知・改善するAI公平性技術。学習データの偏りなどが原因で、ある特定のグループに対して意図せず不公平な結果を導き出してしまうような問題に対処する。「これまで見過ごされてきた、年齢や性別、国籍などの複数の属性が特定の条件で組み合わされたときに現れる交差バイアスも容易に検知して改善する」(同社)としている。

図2は、あるテストの合格率である。年齢と性別を組み合わせて分析すると、グループに所属する人数の違いが原因で、若年女性の合格率が33.3%と、残りのグループの合格率と比較して極端に低くなっている。「これは属性を組み合わせてはじめて顕在化するバイアスである。こうしたバイアスに対してAI公平性技術を用いると、グループごとのバイアスの調整策を作成し、調整策をグループ全体の観点から再調整して合格ラインを決定できる」(富士通)。

図2:Intersectional Fairnessを通じて検出・改善可能な、気づきづらい交差バイアスの例(出典:富士通)

図2:Intersectional Fairnessを通じて検出・改善可能な、気づきづらい交差バイアスの例(出典:富士通)拡大画像表示